Künstliche Intelligenz verändert nicht nur unsere Arbeitsweise, sondern stellt auch Führungskräfte vor völlig neue Herausforderungen. Dr. Tina Weisser, Professorin an der Hochschule München und Expertin für Innovationsentwicklung, forscht intensiv zu Human-Agent-Teams – also Teams, in denen Menschen und KI-Systeme zusammenarbeiten. Im Gespräch mit zero360 gibt sie Einblicke in die Führung von morgen.

Kannst du uns ein wenig über dich, deinen Weg und deine heutige Arbeit erzählen?

Während meines Ingenieursstudiums habe ich mich mit Anfang 20 selbstständig gemacht und ein Medienunternehmen gegründet, in einer Zeit, in der das Internet gerade begann, unsere Welt zu verändern und eine Aufbruchsstimmung herrschte. Diese Pionierjahre waren geprägt von Experimenten, Tempo und einem tiefen Vertrauen in Gestaltungskraft.

Nach neun intensiven Jahren und erfolgreichem Aufbau spürte ich, ich brauche neue Horizonte. Also nahm ich ein Sabbatical und richtete mich strategisch neu aus und tauchte tief in Innovationsentwicklung und systemische Organisationsberatung ein. In dieser Zeit begann mein Fokus sich zu schärfen: Wie können Menschen Wandel gestalten, wenn die Zukunft ungewiss ist? Vor drei Jahren übernahm ich die Leitung des Studiengangs „Informatik und Design“ am KI-Hub der Hochschule München, genau in dem Moment, als KI durch ChatGPT massentauglich wurde.

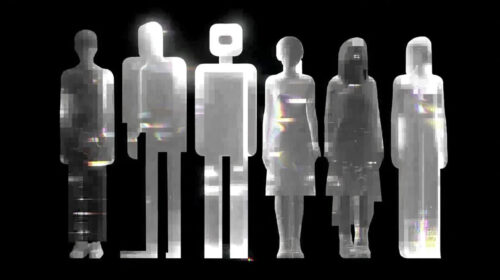

Heute forsche und lehre ich dazu, wie Führung in komplexen, KI-gestützten Umfeldern gelingt, mithilfe von Service Design und mit Blick auf die Mensch-Technologie-Interaktion von morgen. Dabei geht es nicht nur um technische Systeme, sondern um die Gestaltung von Beziehungen, Entscheidungen und Erfahrungen in hybriden Teams aus Menschen und intelligenten Agenten.

Wie können Menschen Wandel gestalten, wenn die Zukunft ungewiss ist?

In meiner Beratung begleite ich Führungskräfte an genau dieser Schnittstelle: Technologie, Verantwortung und Transformation. Mein zentrales Thema ist Führen in Unsicherheit. Denn in Innovations- und Transformationsprozessen gibt es selten klare Antworten, aber immer die Chance, mit Klarheit, Haltung und Verantwortung Räume für Orientierung zu schaffen. Gerade in der Mensch-KI-Kollaboration braucht es Führung, die Vertrauen aufbaut, Entscheidungen ermöglicht und zugleich technologiekompetent agiert. Das ist aus meiner Sicht die zentrale Führungsaufgabe.

Viele Menschen beschäftigt aktuell eine existenzielle Frage, ob KI den eigenen Job ersetzen oder entwerten wird. Was steckt hinter dieser existenziellen Angst? Und was müssen Führungskräfte loslassen – und was neu lernen –, um in einer Welt intelligenter Agenten relevant zu bleiben?

Die Angst ist real, denn viele Berufe werden sich massiv verändern. In manchen Bereichen werden deutlich weniger Menschen benötigt, in anderen mehr. Ein Blick zurück hilft beim Verstehen: Als die agile Transformation begann und klassische Hierarchien infrage gestellt wurden, hieß es oft, Führung werde überflüssig. Doch das Gegenteil trat ein. Führung wurde nicht abgeschafft, sie musste nur anders gedacht werden. Genau an diesem Punkt stehen wir heute wieder.

Für Führungskräfte bedeutet das: Die Vorstellung, immer alle Antworten zu haben und die Illusion von Kontrolle loszulassen. Unsicherheit wird zur neuen Normalität – und zwar auf mehreren Ebenen gleichzeitig: in Projekten und Lösungen, der eigenen Rolle, den Team- und den gesamten Organisationsstrukturen.

Unsicherheit wird zur neuen Normalität – und zwar auf mehreren Ebenen gleichzeitig: in Projekten und Lösungen, der eigenen Rolle, den Team- und den gesamten Organisationsstrukturen.

Wir forschen gerade viel zu Multi-Agenten-Systemen, die beispielsweise neue Wege im Wissensmanagement eröffnen: Sie lassen sich mit unternehmensspezifischem Wissen anreichern und dezentral nutzen – ganz ohne klassische Hierarchie – mit individuell definierten Skills und Wissensbereichen. Unternehmen können dort ihre spezifischen Methoden, wichtige Studien und Strategien hinterlegen. Diese Wissens-Hubs lassen sich dann überall im Unternehmen teilen, ohne dass eine hierarchische Organisation erforderlich ist. Das klassische, aufgeräumte Organigramm, das uns Sicherheit gibt, könnte sich völlig anders sortieren und anstatt dessen könnten mehr Netzwerkstrukturen entstehen. Und den Überblick in diesen Netzen zu behalten, wird zur neuen Führungsaufgabe.

Einen anderen spannenden Use Case für Multi-Agenten zeigt sich hier: Bei Start-ups ist der Grund, warum man etwas macht, überall präsent. In großen Organisationen gibt es jedoch ab einer gewissen Schwelle eine Strategiediffusion: Viele Mitarbeitende wissen nicht mehr genau, was sie warum und wofür machen. Wenn Multi-Agenten im Hintergrund laufen, könnten auch größere Organisationen wirklich purpose-driven werden, da KI-Systeme Strategie und Vision kontinuierlich präsent halten und für die jeweiligen Anwendenden in konkrete Maßnahmen übersetzen.

Übernehmen KI-Systeme Wissensmanagement und automatisieren Routinen, entfallen zwei klassische Bereiche der Führungsarbeit. Studien sind sich weitgehend einig, dass Führungskräfte sich neu definieren müssen. Ihr Fokus verschiebt sich hin zu dem, was KI nicht leisten kann: Verantwortung übernehmen, kreativ und kritisch denken und Sinn stiften. Genau hier beginnt zukunftsfähige Führung – im Zusammenspiel von Mensch und Technologie.

Wir sehen einen Trend hin zur Führungskraft als Orchestrator – jemand, der verschiedene KI-Systeme und Menschen koordiniert. Welche neuen Kompetenzen brauchen Manager dafür, die in keinem klassischen Leadership-Buch stehen?

Eine Schlüsselkompetenz ist Data Literacy. Führungskräfte haben jetzt die Herausforderung zu verstehen: Welche Daten haben wir überhaupt? Welche Qualität haben sie? Wie arbeiten wir damit?

Ebenso wichtig ist die ethische Kompetenz, also die Fähigkeit, zu bewerten, was wir einerseits mit KI tun können versus was wir tun sollten und dürfen. Das erfordert ein gesundes Maß an Vertrauen in KI-Systeme, ohne dabei unkritisch zu werden.

Besonders zentral wird die Auswahlkompetenz. Wenn alle Teammitglieder mit persönlichen KI-Agenten arbeiten, müssen Führungskräfte ständig bewerten und auswählen. Welcher Output ist relevant? Habe ich genug Vorwissen, um das einzuschätzen? Diese Bewertungsfähigkeit ist entscheidend, denn es ist das eine, gute Fragen zu stellen, und das andere, mit dem Output sinnvoll umzugehen.

Dabei lauert eine Gefahr: KI kann auch zu mehr „Fake Work“ führen. Wenn jede:r Präsentationen mit KI schreiben lässt und sie mit Worthülsen aufbläht, müssen andere sie am Ende wieder in die KI eingeben, um sie zusammenfassen zu lassen. Wir beobachten, dass viel Arbeit entsteht, die keine echte Wertschöpfung bringt.

KI kann auch zu mehr ‚Fake Work‘ führen – viel Arbeit entsteht, die keine echte Wertschöpfung bringt

Schließlich werden Resilienz und Growth Mindset in einer neuen Dimension wichtig. Entscheidend ist die Fähigkeit, dranzubleiben, auch wenn sich die eigene Kompetenz zeitweise brüchig anfühlt. Freitag funktioniert ein KI-Modell noch, am Montag gibt es ein anderes und alles muss wieder neu gelernt werden. Diese Offenheit für ständiges Lernen wird zur zentralen Stärke in einer sich permanent verändernden KI-Landschaft.

Welche neuen Rollen wird es in Human-Agent-Teams geben und wie können Führungskräfte ihre Teams konkret unterstützen, um in dieser neuen Welt optimal arbeiten zu können?

Zunächst benötigen wir auf technischer Ebene Support-Rollen. Künftig hat jedes Team seine maßgeschneiderte Software in Form von Agentensystemen, die genau auf die jeweiligen Bedürfnisse zugeschnitten sind. Diese Systeme müssen gewartet werden. Es braucht Admins, die eingreifen können, wenn die Ergebnisse nicht korrekt sind. Bei den bereits überlasteten IT-Abteilungen ist das eine echte Herausforderung.

Dann gibt es die Orchestrierungsebene. Führungskräfte müssen transparent machen, was im Hintergrund läuft. Wenn im Team Fehler passieren, stellt sich die Frage: Wer übernimmt die Verantwortung? Wie verteilen wir die Rollen, wenn acht Menschen mit zehn Agentensystemen zusammenarbeiten? Wie gehen wir mit Risiken um? Was, wenn das System heute ausfällt oder Unsinn produziert?

Ich glaube aber, dass wir weniger an klassische Rollen denken sollten, sondern mehr an Fähigkeiten, ähnlich wie in agilen Teams. Die Frage muss lauten: Welche Kompetenzen brauchen wir? Und bei jedem Profil müssen wir uns fragen: Was davon übernehmen die Agenten, was muss der Mensch leisten? Der Mensch muss im Loop bleiben und immer die Verantwortung tragen.

Um Teams dabei konkret zu unterstützen, ist Weiterbildung entscheidend. Unternehmen investieren in Tools und technisches Setup, aber zu wenig in Weiterbildung und praktische Anwendung. Ein paar Webinare reichen nicht aus. Es braucht eine Infrastruktur, damit überhaupt gearbeitet werden kann, sowie Grundschulungen: Wie promptet man, wofür sind verschiedene Modelle gut? Und dann ist dauerhaftes Ausprobieren und Lernen erforderlich, weil sich alles permanent verändert. Prompts, die vor einem Jahr funktioniert haben, funktionieren vielleicht jetzt nicht mehr, weil ein neues Modell herauskommt und alles völlig anders läuft.

In der Praxis haben wir gesehen, dass Safe Spaces mindestens genauso wichtig sind: Experimentier- und Lernräume mit psychologischer Sicherheit, in denen Fehler erlaubt sind und nicht alles sofort perfekt sein muss. Kontinuierlich im Gespräch zu bleiben, hilft dabei enorm. Was vertraut ist, was man wiederholt hört, verliert seinen Schrecken. Erfolgsgeschichten teilen, transparent sein über das, was gesetzt ist und was experimentell bleibt – das schafft die nötige psychologische Sicherheit. Das bestätigen auch aktuelle Studien zur Einführung von KI in Organisationen: Psychologische Sicherheit ist ein zentraler Faktor für Lernbereitschaft, Innovationskraft und nachhaltige Integration neuer Technologien.

Safe Spaces sind mindestens genauso wichtig wie Weiterbildung: Experimentier- und Lernräume mit psychologischer Sicherheit, in denen Fehler erlaubt sind.

Wenn ganze Organisationen KI nutzen, um Entscheidungen vorzubereiten – müsste dann nicht auch das Board der KI einen Platz am Tisch geben?

Wenn ganze Organisationen KI nutzen, um Entscheidungen vorzubereiten – braucht es auch auf Vorstandsebene eigene agentische Systeme. Systeme, die Wissen strukturieren, Zusammenhänge sichtbar machen, bereichsübergreifendes Denken fördern und Entscheidungsprozesse unterstützen. Doch der entscheidende Punkt ist nicht, ob KI formal einen Platz am Tisch bekommt, sondern ob Führungskräfte bereit sind, Verantwortung neu zu denken, Zeit für tiefes Lernen zu schaffen und Mensch-KI-Zusammenarbeit als Führungsaufgabe zu gestalten. Ohne strategische Auseinandersetzung, klare Prinzipien und kulturelle Reife bleibt KI ein Buzzword, statt ein echter Hebel für Transformation.

Wir sehen uns jetzt mit einer Technologie konfrontiert, die Potential hat, ganze Unternehmen grundlegend umzukrempeln: Kein Stein bleibt auf dem anderen und vieles muss neu gedacht werden. Dafür braucht es mehr als Schlagworte. Es braucht Klarheit, Haltung und den Willen, Führung neu zu definieren.

Ohne strategische Auseinandersetzung, klare Prinzipien und kulturelle Reife bleibt KI ein Buzzword, statt ein echter Hebel für Transformation.

Wie schaffe ich als Führungskraft einen sicheren Raum für Lernen in KI-Experimenten, wenn viele Menschen gerade gleichzeitig sehen, wie KI ganze Berufe obsolet macht?

Das ist tatsächlich eine der größten Herausforderungen. Wir erleben teilweise Schwarmphänomene: Ein Unternehmen entlässt Mitarbeitende aus einem Bauchgefühl heraus, andere folgen reflexartig. Diese Wellen sind gefährlich, weil Führungskräfte, die weit weg vom Operativen sind, oft nur schwer einschätzen können, welche Aufgaben und Kompetenzen tatsächlich gebraucht werden.

Um dennoch sichere Lernräume zu schaffen, braucht es vor allem vier Dinge:

Erstens: Klarheit schafft Sicherheit

Führungskräfte sollten offen benennen: Was ist gesetzt? Was darf ausprobiert werden? Welche Bereiche sind stabil – und wo besteht Veränderungsdruck? Diese Transparenz reduziert Unsicherheit und schafft Vertrauen.

Zweitens: Motivation trotz Frust

Diese Transformation ist anstrengend. Viele Versuche verlaufen im Sand, vieles ändert sich ständig. Resilienz heißt: anzuerkennen, dass Lernen scheitert und trotzdem weiterzumachen. Ehrlich zu sagen: „Ich weiß es auch nicht. Lasst uns gemeinsam herausfinden, wie es geht“, ist heute eine der stärksten Formen von Leadership.

Ehrlich zu sagen: ‚Ich weiß es auch nicht. Lasst uns gemeinsam herausfinden, wie es geht‘ – das ist heute eine der stärksten Formen von Leadership.

Drittens: Ambivalenz aushalten statt Sicherheit vorspielen

Weder naive Technikbegeisterung noch pauschale Ablehnung helfen weiter. Es geht darum, die Spannung auszuhalten: Die Freude über neue Möglichkeiten und die Sorge über reale Risiken. Führung bedeutet, diese Ambivalenz transparent zu machen. Nicht, sie zu verstecken.

Viertens: Gemeinsam lernen und nicht allein kämpfen

Wer isoliert ist, verliert schneller den Mut. Peer-Groups, Lern-Communities und kollaborative Räume schaffen psychologische Sicherheit und fördern kollektive Intelligenz. Denn am Ende gilt: Was man gemeinsam versteht, macht weniger Angst.

Wie gehe ich als Führungskraft damit um, wenn meine KI eine Entscheidung getroffen hat, und deren Konsequenzen ich am Montagmorgen verantworten muss? Wie schaffen wir die Balance zwischen kritischem Denken und Effizienz?

Die grundlegende Frage lautet: Was kann autonom entschieden werden und was nicht? Diese Grenzziehung ist keine technische, sondern eine Führungsentscheidung. Wenn Themen sehr kritisch sind und ein hohes Risiko bergen, sollten sie nicht vollständig autonom behandelt werden.

Wurde eine schlechte autonome Entscheidung getroffen, ist das ein Systemdesign-Problem. Dann wurde eine Entscheidung delegiert, die nicht delegierbar war. Das ist vergleichbar mit der Delegation in einem menschlichen Team: Wenn man eine Aufgabe an eine Person delegiert, die die nötige Erfahrung nicht hat, und es geht schief, muss man die Verantwortung übernehmen.

Die Balance zwischen kritischem Denken und Effizienz liegt im durchdachten Design und der Architektur dieser Systeme. Es braucht mehr als eine Sammlung von Use Cases. Es wird enorm viel Arbeit kosten, solche Systeme so zu gestalten, dass sie wirklich helfen, statt zu frustrieren und Schaden anzurichten.

Das Thema Effizienz ist übrigens trügerisch. Ja, es kann irgendwann effizienter werden, aber sicher nicht von Anfang an. Am Anfang steht eine massive Investition: in Denkarbeit, in ethische Klärung, in Governance und in das Zusammenspiel von Technologie, Mensch und Organisation.

Am Anfang steht eine massive Investition: in Denkarbeit, in ethische Klärung, in Governance und in das Zusammenspiel von Technologie, Mensch und Organisation.

Was sollte eine Führungskraft diese Woche beginnen, um vom KI-Experimentierer zur Human-Agent Team Leader zu werden?

Mein erster Tipp ist – suche dir andere Führungskräfte, idealerweise auch aus anderen Unternehmen, und etabliere einen regelmäßigen Lern- und Austauschkreis. Verankere diese Treffen verbindlich im Kalender – es geht um gemeinsames Lernen auf Augenhöhe, eine Art Supervisions- und Lernzirkel. Diese Transformation ist in Isolation kaum zu bewältigen.

Zweitens, weniger LinkedIn-Posts lesen, weniger Branchenreports wälzen – stattdessen selbst experimentieren. Versuche, eigene Agentensysteme aufzusetzen oder zumindest durchzudenken. Sammle eigene Erfahrungen, statt dich auf theoretisches Wissen anderer zu verlassen. Nur durch praktisches Tun entwickelst du ein Verständnis dafür, was funktioniert und was nicht.

Wir stehen am Anfang einer tiefgreifenden Veränderung. Wir sehen erst die Spitze des Eisbergs. Aber Führungskräfte, die jetzt neugierig bleiben, ausprobieren, reflektieren und sich vernetzen, werden ihre Teams am wirksamsten durch diese Transformation begleiten können.

Weniger LinkedIn-Posts lesen, weniger Branchenreports wälzen – stattdessen selbst experimentieren. Nur durch praktisches Tun entwickelst du ein Verständnis dafür, was funktioniert.

Weiterführende Ressourcen

Möchtest du mehr über die Zukunft der Führung im KI-Zeitalter erfahren?

📘 Handbuch KI-integrierte Teams

📘 zero360 Academy: AI Leadership Programm

Blog-Artikel zum Thema Transformation und Führung:

📰 9 Prinzipien erfolgreicher Transformation

Verfasst von:

Désirée Seibel